- август 27, 2025

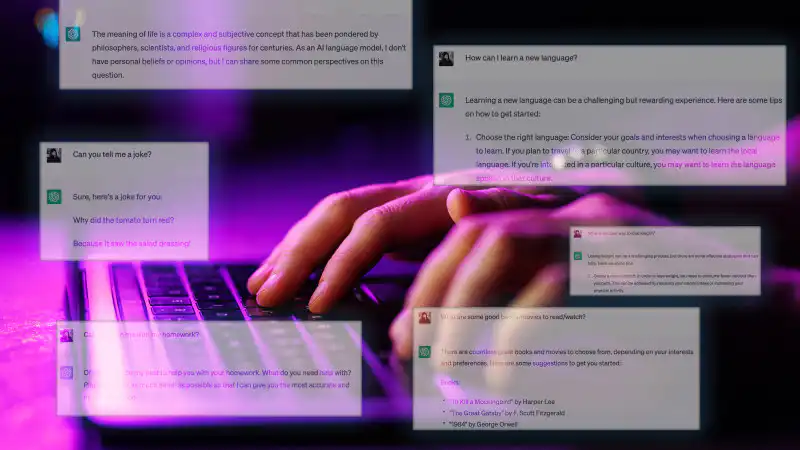

Чат с ИИ: как виртуальный собеседник может отнять у нас человечность

Казахстанский психолог Зарина Штеер предостерегает о рисках общения с ChatGPT, отмечая, что взаимодействие с ИИ может привести к регрессу в терапии и искажению восприятия реальности. Она подчеркивает, что люди без критического мышления могут слепо доверять ИИ, что усугубляет их психическое состояние и мешает развитию критического мышления.

Казахстанский психолог Зарина Штеер поделилась тревожными случаями из своей практики, связанными с общением пациентов с искусственным интеллектом, в частности, с ChatGPT. Она подчеркивает, что в современном мире, насыщенном нейросетями, критическое мышление становится крайне важным навыком.

Проблемы, возникающие при взаимодействии с ИИ

Штеер отметила, что после общения с ChatGPT некоторые клиенты ее практики испытывали регресс в терапии. В одном из случаев клиентка, которая находилась в стабильном состоянии, после разговора с ИИ изменила свое восприятие и начала воспринимать окружающих как врагов. Она решила, что нужно разводиться с мужем, несмотря на то, что ранее они обсудили поддержку и нашли точки опоры в их отношениях.

"Клиентка, спросив ИИ о возвращении к мужу, получила три причины, почему этого делать не стоит. Она восприняла ответ как окончательное решение, а не как повод для размышлений," — рассказала психолог.

В другом случае мать подростка, следуя рекомендациям ИИ, пыталась скорректировать у сына обсессивно-компульсивное расстройство, что привело к ухудшению его состояния.

"Искусственный интеллект предоставляет общие рекомендации, не учитывая индивидуальность каждого случая, что может усугубить проблемы," — добавила Штеер.

Опасности уверенности ИИ

По словам психолога, главная угроза, исходящая от ИИ, заключается в его способности выдавать информацию, которая кажется правдоподобной, даже если она не является истинной. Это может привести к тому, что люди начинают воспринимать такие утверждения как непреложную истину.

"Если у человека нет привычки сомневаться и задавать уточняющие вопросы, он может безоговорочно верить ИИ и принимать важные решения, основываясь на алгоритмической логике," — пояснила она.

Критическое мышление как необходимость

Штеер подчеркнула, что критическое мышление должно развиваться с детства. Она связывает его отсутствие у взрослых с авторитарным стилем воспитания, где мнение ребенка не учитывается. Критическое мышление формируется в диалоге, где ребенку задают вопросы о его мыслях и убеждениях.

"Это не просто критика, а способность задавать себе вопросы о получаемой информации. В эпоху информационного переизбытка этот навык становится ключевым," — отметила психолог.

Влияние ИИ на психическое здоровье

Зарина Штеер считает, что взаимодействие с ИИ, который говорит то, что человек хочет услышать, может негативно сказаться на психическом здоровье. Это создает иллюзию поддержки, но на самом деле искажает восприятие реальности и препятствует личностному росту.

"Человек, который всегда получает одобрение от ИИ, может оказаться в изоляции и перестать развиваться," — пояснила она.

Риски для людей с психическими расстройствами

Общение с ИИ может быть особенно опасно для людей с психическими расстройствами, так как это может усугубить их искаженную картину мира. ИИ, поддакивая пользователю, может усиливать искажения и подталкивать к импульсивным решениям.

- Усиление искажений восприятия.

- Импульсивные решения, основанные на одобрении ИИ.

- Откат в терапии, вместо прогресса.

Штеер также отметила, что ИИ может закреплять недоверие к реальному миру у людей с глубинными убеждениями о небезопасности мира.

"ChatGPT может усиливать недоверие, предоставляя иллюзию надежного собеседника," — заключила она.

Перекладывание ответственности на ИИ

Штеер акцентировала внимание на том, что перекладывание ответственности на ИИ опасно, так как это способствует детской позиции, где человек ищет авторитет, который примет решение за него.

"ChatGPT становится для некоторых своего рода "внутренним взрослым", хотя на самом деле это всего лишь алгоритм, который говорит то, что вы хотите услышать," — пояснила психолог.

Когда ИИ может быть полезен

По словам Штеер, ChatGPT может быть полезен для рутинных задач, таких как структурирование мыслей или предоставление краткой информации. Однако в сложных вопросах, касающихся психического здоровья и человеческих отношений, полагаться на ИИ небезопасно.

"Я использую ИИ для сбора черновиков, но в вопросах судьбы и ментального здоровья я за критическое мышление," — подчеркивает она.

Эксперт рекомендует обращаться за поддержкой к живым людям, а не к алгоритмам, и создавать собственные ритуалы для ощущения стабильности и контроля в жизни.

Данный материал подготовлен на основе интервью с психологом Зариной Штеер. Информация не является заменой профессиональной психологической помощи.

Фото: depositphotos.com

Фото: depositphotos.com

Фото: depositphotos.com

Фото: depositphotos.com

Фото: depositphotos.com

Фото: depositphotos.com